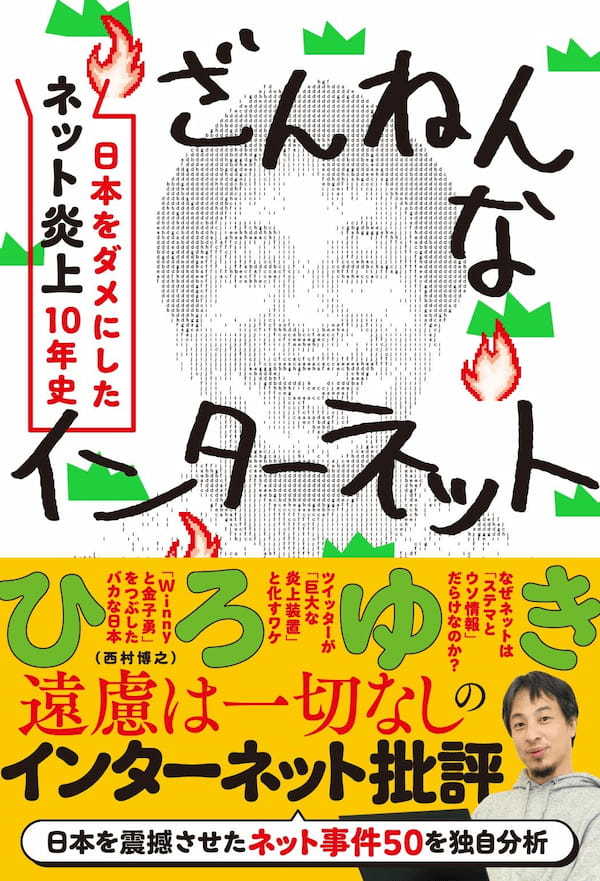

(本記事は、ひろゆき氏の著書『ざんねんなインターネット 日本をダメにした「ネット炎上」10年史』=扶桑社、2023年3月29日刊=の中から一部を抜粋・編集しています)

【現在のひろゆきが振り返る2010年】

ツイッターと動画プラットフォームが「巨大な炎上装置」になったワケ

2010年当時は、インターネットといってもガラケーでメールの送受信をするなど、まだ個人間でのやり取りが多かった時代です。

しかし、徐々にネット上のオープンな場所に匿名ではない状態で書き込みをしたり、動画をアップしたりする人が増えてきました。

そんななかで急速に人気を得ていったのがツイッターです。2008年に日本版がリリースされたツイッターは、2010年に国内利用者数が1000万人を突破。

それと同時に、ツイッター発の炎上騒ぎも年々増えていきました。当時の連載で扱った「なりすましアカウント問題」などもそのひとつですね。

ツイッターでの炎上がどんどん増えたのには理由があります。そもそも、炎上という現象が生じるには「個人名」が出ていないと始まらないからです。

SNSが流行する前は、個人が発信する場はブログや掲示板サイトがメインで、誰が書いたのかもわからない投稿内容が多かったです。例えば2ちゃんねるにもおかしな人はいましたが、やはり個人名は特定できませんでした。

しかし、ツイッターが登場し、個人が発信しやすいだけでなく「誰が書いたのかがわかる」という状況が生まれ、おかしな行動をした人が特定されやすくなりました。

ツイッターは基本的にテキストでのコミュニケーションなので、投稿ハードルが圧倒的に低い。一日に何十回も発信する人もいますし、そこに「発言者がわかる」という要素が重なることで、炎上の発生確率がグッと高まったわけです。

それに対して、2ちゃんねるは炎上の発生源ではなく、「誰かがやらかした」という話題を広げる「炎上拡散装置」としての役割が大きいのです。

例えば、2010年最大のネット発の事件だった「尖閣諸島のビデオ」が典型的です。

この動画はユーチューブに投稿された後、2ちゃんねるに書き込まれたことで一気に火がつきました。当時はユーチューブにアップしても誰かが見つけなければ埋もれてしまうので、人目につくよう2ちゃんねるに書き込んだわけですね。

また、ツイッターが政治的な工作活動に使われだしたのもこの頃からです。2010年には当時の東京都知事だった石原慎太郎さんを推すコメントを書きまくるアカウントが大量発生し、「工作活動ではないか?」と疑われて炎上騒ぎにもなっています。

なぜこういったことが起きるかといえば、候補者ではなく「誰かが勝手に推すコメントを出している」という体裁にすれば、公職選挙法違反にならないから。現在はこれが動画に置き換わり、候補者以外が動画をアップしても問題にはなりません。

本来の法律の趣旨からすれば公職選挙法違反になりそうな投稿も多々あると思うのですが、実際は「やったもの勝ち」です。そうやって選挙の仕組みをハックしていくのは、2010年頃から始まったような気がします。

動画プラットフォームの進化とともに「バカ投稿主」も増殖する

ツイッター以外にも、この頃からは様々な動画プラットフォームの発展に伴い、動画を発生源にする炎上も増えてきました。

なかにはバカな大学生が「ドブスを守る会」という動画をユーチューブに投稿して炎上するなんて事態も……。これなどは今も同じような炎上を繰り返していますよね。

学生がおかしな行為を自らネットに上げて炎上していますが、そんなことは昔からあるのです。スマホの普及率を考えれば、こうした炎上は今後も変わらずに続いていくでしょう。

2010年にはほかにも、ライブ動画配信サービスの先駆けだった「ユーストリーム」で自殺の様子を生中継した投稿が問題になりました。30代以上の人なら、そのサービス名を聞くだけで懐かしさを感じる人もいるかもしれませんね。

当時は一世を風靡したユーストリームですが、2016年に運営元の米UstreamがIBMに買収され、2017年には「IBM Cloud Video」というサービスに変わっています。

そのように移り変わりの激しい動画業界ですが、この頃に比べると最近は過激な生配信が減ったように感じる人がいるかもしれません。

でも実は、「単に消されるのが早い」というだけで、どの動画配信プラットフォームでも今なお過激な生配信が行われています。すぐに消えるので気づかれづらいだけです。

なぜ削除されるのが早くなったのか。その理由に、AI技術の発展を思い浮かべる人も多いでしょう。

たしかにその側面はありますが、実はすべてAIが監視して自動削除しているわけではありません。AIがある程度の絞り込みはするものの、どのサービスでも最後はやはり人間の手で止めていると思われます。

というのも、例えばAIが勝手に判断をして削除できると、相撲やプロレスの動画までAIが「裸の男の人が抱き合っているアダルトな動画」と判断して消してしまう可能性があるからです。これでは逆にトラブルに発展する可能性が出てきます。

ちなみに、動画プラットフォームの黎明期は費用的な問題から深夜帯だと動画を監視する人数が限られていたので、エロ系動画をアップしても朝まで消されないこともありました。

事実、当時のニコニコ動画は「深夜だとエロい生放送が見やすい」なんて状況がわりとあったのです。深夜帯に何百放送も行われているとチェックに時間がかかるので、「10〜20分だったら運営の目を逃れられる」みたいな感じです。

そこから動画プラットフォームが隆盛を極めて儲かったので、人件費をかけやすくなり、監視や削除をするマンパワーが増えた。だから今では危ない動画が目につきにくくなっているのですね。